FastGS: Training 3D Gaussian Splatting in 100 Seconds

arXiv:2511.04283v3 (2025年12月6日公開)

はじめに:次世代の3Dシーン再構成技術「3D Gaussian Splatting」とは

近年、コンピュータビジョンとグラフィックスの分野で「Novel View Synthesis (NVS)」という技術が注目されています。これは、限られた視点からの画像データから、存在しない新しい視点からの画像を生成する技術で、AR/VRや自動運転など幅広い応用が期待されています。

その中でも、「Neural Radiance Field (NeRF)」は、連続的なボクセル関数としてシーンを表現し、非常にリアルな画像を生成することで画期的な成果を上げました。しかし、トレーニングに時間がかかるという課題がありました。

そこに登場したのが、「3D Gaussian Splatting (3DGS)」です。3DGSは、3Dシーンを多数の小さな「3D Gaussian」と呼ばれるプリミティブ(基本要素)の集まりとして表現します。このアプローチは、NeRFに匹敵するレンダリング品質を保ちつつ、トレーニングとレンダリング速度を大幅に向上させました。

3DGSのスピードの裏にある課題

3DGSはその効率性から、動的シーンの再構成、表面再構成、SLAM(自己位置推定と環境地図作成)など、様々なタスクに応用されています。しかし、現在の実用化における大きなボトルネックは、依然として「トレーニング時間」です。

一つのシーンのトレーニングに数十分かかることが多く、従来の3DGSのトレーニングパイプラインには、主に2つの限界があります。

一つは、Gaussianの適応的な密度制御(ADC)が、しばしば「冗長なGaussian」を大量に生成してしまうこと。もう一つは、レンダリングパイプライン自体の非効率性です。

特に、この「冗長なGaussian」の生成が、計算オーバーヘッドを増やし、トレーニング時間を延ばす主要な原因となっていました。

FastGS:トレーニングを100秒に短縮する画期的なフレームワーク

本論文で提案された「FastGS」は、この3DGSのトレーニング時間に関する課題を劇的に解決する、新しい、シンプルで汎用的な高速化フレームワークです。

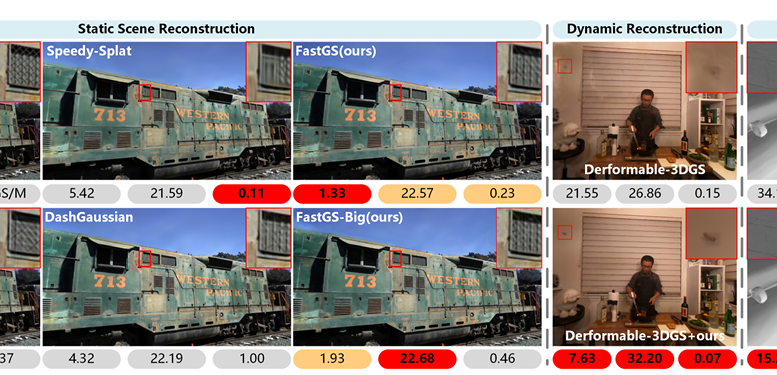

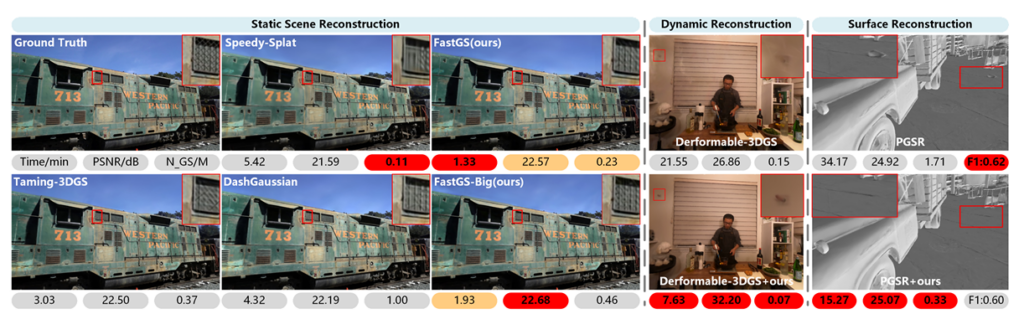

FastGSは、レンダリング品質を犠牲にすることなく、トレーニング時間を大幅に短縮します。驚くべきことに、静的シーンでは「Tanks & Temples」データセットのトレーニングをわずか100秒以内で完了できます。

さらに、動的シーンの再構成では2.82倍、表面再構成では2.24倍も高速化を実現しています。

冗長なGaussianをなくす鍵:マルチビュー一貫性

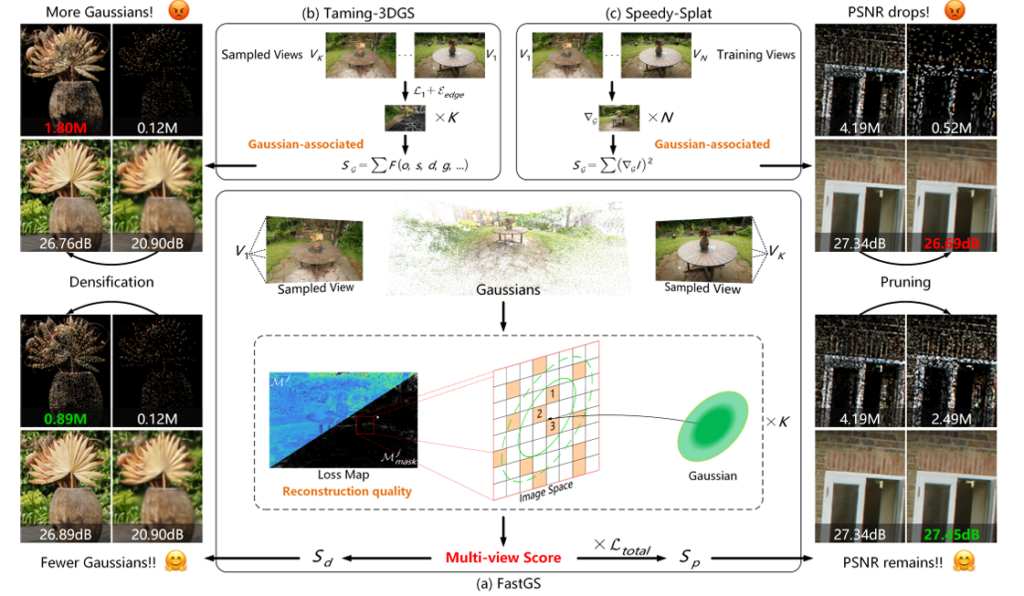

FastGSの核心にあるのは、マルチビュー一貫性(multi-view consistency)という考え方です。従来の加速化手法の多くは、Gaussianの数を適切に制御できず、冗長なGaussianを生成していました。

FastGSは、各Gaussianの重要度を「マルチビューにおける再構成品質への貢献度」に基づいて評価するという革新的なアプローチを採用しています。これにより、どのGaussianが密化されるべきか、あるいは剪定されるべきかを正確に判断できるようになりました。

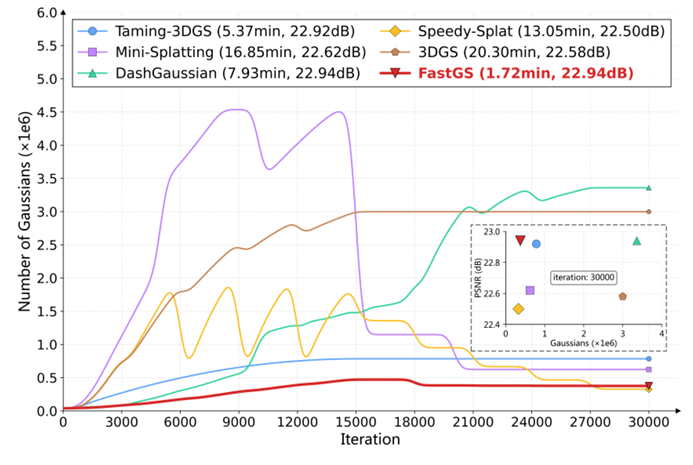

この効果は、トレーニング中のGaussian数の推移を見ると明らかです。下のグラフが示すように、FastGSは他の手法と比較して、トレーニング全体を通してGaussianの数を一貫して低いレベルに保つことができます。

FastGSの主要なコンポーネント

FastGSは、主に以下の3つの戦略によって高速化を実現しています。

1. Multi-view Consistent Densification (VCD)

従来の3DGSは、画像の勾配に基づいてGaussianを密化していましたが、これが冗長なGaussianを大量に生み出す原因でした。

VCDは、複数の学習画像からランダムにK枚のビューをサンプリングし、各ピクセルのL1損失(レンダリング画像と正解画像の色差)を計算してエラーマップを作成します。

そして、各Gaussianの2D投影範囲内にある「高エラーピクセル」の数を、サンプリングされた複数のビューにわたって平均することで「重要度スコア」を計算します。このスコアが閾値を超えたGaussianのみを密化の候補とすることで、本当に再構成が必要な領域にのみ新しいGaussianが追加され、冗長性を回避します。

2. Multi-view Consistent Pruning (VCP)

既存の剪定戦略は、多くの場合、冗長なGaussianを効果的に除去できなかったり、レンダリング品質を著しく低下させたりする問題がありました。

VCPもVCDと同様に、各Gaussianが「マルチビューの再構成品質の劣化」にどれだけ貢献しているかを評価します。具体的には、各ビューにおける画像のフォトメトリック損失(L1損失とSSIM損失の組み合わせ)と、高エラーピクセル数の情報を組み合わせて「剪定スコア」を算出します。

このスコアが特定の閾値を超えたGaussianは、マルチビューのレンダリング品質にとって貢献度が低いと判断され、除去されます。これにより、レンダリング品質を維持しつつ、真に冗長なGaussianを効果的に排除します。

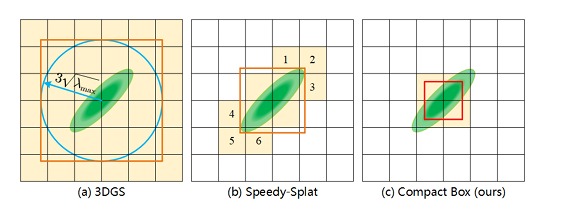

3. Compact Box (CB)

さらにFastGSでは、ラスタライズの効率を向上させるために「Compact Box (CB)」を導入しています。

3DGSのレンダリングプロセスでは、3D Gaussianが2D画像平面に投影され、その2D楕円が影響を与えるタイル(領域)内のピクセルに寄与します。しかし、従来の3DGSや先行研究では、まだ多くの不必要なGaussian-タイルペアが生成され、計算の冗長性につながっていました。

CBは、Speedy-Splatの精密なタイル交差戦略をさらに発展させ、Gaussianの中心からのマハラノビス距離に基づいて、レンダリングへの寄与がごくわずかなGaussian-タイルペアを剪定します。これにより、ラスタライズがさらに高速化されます。

驚くべき汎用性と幅広い応用

FastGSの最大の特徴の一つは、その高い汎用性です。

静的シーンの再構成だけでなく、動的シーン再構成、表面再構成、疎視点再構成、大規模再構成、さらにはSLAM(自己位置推定と環境地図作成)といった多岐にわたるタスクで、既存の最先端(SOTA)手法と組み合わせることで、2~6倍のトレーニング高速化を実現しています。

FastGSは、様々な3DGSベースのバックボーンモデルにも簡単に適用でき、3~8倍の高速化を達成しながら、同等のレンダリング品質を維持します。これは、マルチビュー一貫性というアプローチが、様々な再構成タスクの根本的な課題にアプローチしていることを示しています。

また、本論文では、さらに高品質を目指すバリアント「FastGS-Big」も紹介されており、最高のレンダリング品質と最速のトレーニング速度を両立させています。

まとめ:3DGSの次なるステップへ

FastGSは、3D Gaussian Splattingのトレーニング時間を劇的に短縮する、シンプルかつ強力なフレームワークです。

特に、マルチビュー一貫性に基づいてGaussianの密化と剪定を厳密に制御する戦略が、冗長なGaussianの生成を防ぎ、高速化の鍵となっています。この研究は、3DGS技術の実用化を大きく前進させるものと言えるでしょう。

現時点ではarXivで公開されていますが、今後、国際会議や論文誌で発表されることが期待されます。今後の3Dシーン再構成技術の発展に、FastGSがどのような影響を与えるか、非常に楽しみです。